Перейти к:

Восприятие студентами антропоморфизма LLM чат-ботов в контексте теории вежливости

https://doi.org/10.23947/2414-1143-2025-11-4-19-28

Аннотация

Введение. В современном контексте, особенно в связи с развитием и активным внедрением больших языковых моделей (БЯМ) в социальные практики, феномен антропоморфизма приобретает особое прагматическое значение. Образование сегодня является одной из сфер, где внедрение БЯМ происходит наиболее активно. Данное исследование направлено на рассмотрение феномена антропоморфизма в восприятии студентами чат-ботов в контексте теории вежливости.

Материалы и методы. Использована адаптированная версия опросника Godspeed с измерением антропоморфизма, одушевленности и воспринимаемой разумности. Коммуникативные стратегии чат-ботов сконструированы на основе теории вежливости П. Браун и С. Левинсона. В эксперименте приняли участие 543 студента (возраст 17–20 лет) из трех российских вузов. Специально для эксперименты были разработаны три чат-бота: Номи (ликосохраняющий), Вектор (ликоугрожающий) и Серо (нейтральный). Испытания проводились в трех коммуникативных фреймах: объяснение, обратная связь и рекомендация; каждое взаимодействие студента с чат-ботом длилось не более 10 мин.

Результаты исследования. Вектор получил наивысшую среднюю оценку антропоморфизма (M = 3,123) по сравнению с Серо (M = 2,598) и Номи (M = 2,924). Обнаружено, что восприятие чат-ботов расслаивается: у Вектора высокое ощущение человекоподобности сочетается с более низкими показателями одушевленности и разумности. Показно, что фрейм обратной связи усиливает антропоморфизацию чат-ботов, тогда как рекомендации — нет. Значимой корреляций с опытом использования ИИ не обнаружено.

Обсуждение и заключение. Антропоморфизм является многомерным и контекстуально зависимым феноменом. Активное использование технологий ИИ в повседневной жизни приводит к частичной диссоциации ранее тесно связанных концептов: человекоподобия, одушевленности и воспринимаемой рациональности, а также трансформации некоторых фреймов социального взаимодействия, в которые активно встраиваются цифровые партнеры.

Ключевые слова

Для цитирования:

Филатова А.А., Ли А.А. Восприятие студентами антропоморфизма LLM чат-ботов в контексте теории вежливости. Научный альманах стран Причерноморья. 2025;11(4):19-28. https://doi.org/10.23947/2414-1143-2025-11-4-19-28

For citation:

Filatova A.A., Li A.A. Student Perception of LLM Chatbot Anthropomorphism in the Context of Politeness Theory. Science Almanac of Black Sea Region Countries. 2025;11(4):19-28. https://doi.org/10.23947/2414-1143-2025-11-4-19-28

Введение. Сам термин «искусственный интеллект» отражает характерную для человека склонность концептуализировать машины, выполняющие сложные вычислительные задачи, в антропоморфных терминах [3]. Люди с завидным постоянством демонстрируют то, что Л. Флориди называет «семантической парейдолией» [5], то есть приписывают технологиям ментальные состояния, убеждения, намерения и эмоции. Эта когнитивная особенность проявляется не только в восприятии технических устройств: на протяжении истории люди антропоморфизировали природные объекты, животных, орудия труда и сакральные артефакты.

Существует значительное количество теорий, объясняющих склонность людей «очеловечивать» нечеловеческое. В частности, трехфакторная теория антропоморфизма [4] выделяет три ключевые детерминанты данного феномена. Во-первых, высокая доступность знаний о самих себе делает это знание наиболее очевидным при вынесении индуктивных суждений о других сущностях. Поэтому дети, испытывающие дефицит знаний о мире, чаще проецируют собственные характеристики на внешние объекты. Во-вторых, антропоморфизм может служить способом преодоления неопределенности и когнитивной сложности, помогая экономить ресурсы при интерпретации поведения агента и повышая уверенность в предсказаниях его действий. В-третьих, процесс «очеловечивания» компенсирует дефицит социальных связей, вводя в круг общения новых, в том числе цифровых, партнеров.

С социологической точки зрения антропоморфизм рассматривается как результат действия социальных фреймов, в которые помещаются нечеловеческие агенты, например в сценариях консультации, исповеди или психотерапевтического сеанса [16]. Сама форма коммуникации вынуждает человека приписывать другой стороне атрибуты, необходимые для распознавания ситуации и ее реализации.

В современном контексте, особенно в связи с развитием и активным внедрением больших языковых моделей (БЯМ) в социальные практики, феномен антропоморфизма приобретает особое прагматическое значение [8]. «Человекоподобие» становится объектом целенаправленного проектирования, поскольку сходство с homo sapiens усиливает принятие технологии пользователями и повышает доверие к ней [9, 10, 17]. Интерфейсы, расширяющие коммуникативный потенциал чат-ботов, активно интегрируют элементы лингвистического и эмоционального антропоморфизма (особенности языка, интонации, ритм и живость речи) с целью создания эффекта социального присутствия [13, 18].

Этические дискуссии о возможных негативных последствиях антропоморфизации БЯМ акцентируют внимание на том, что чрезмерное «очеловечивание» технологий может формировать завышенные ожидания, снижать критическое мышление, вызывать необоснованное доверие и даже порождать формы идолопоклонства [5, 14]. Тем не менее такие альтернативные подходы, как «голый» инструментализм или постантропный взгляд, пока демонстрируют меньшую эффективность для конструирования повседневных диалоговых практик с ИИ-агентами.

Образование сегодня является одной из сфер, где внедрение БЯМ происходит наиболее активно. Чат-боты начинают выполнять функции персональных тьюторов, ассистентов, консультантов и даже преподавателей [6, 11, 12]. В связи с этим способность обеспечивать эффект социального присутствия за счет человеческой манеры общения становится важной инженерной задачей [7]. Поскольку антропоморфизм не является инвариантом и зависит от когнитивных, ситуационных и культурных контекстов [4], возникает исследовательская повестка, связанная с более глубоким пониманием локальных эффектов человеко-машинного взаимодействия. Во всех ли коммуникативных ситуациях в образовании пользователи в равной степени нуждаются в антропоморфизации собеседника? Очевидно, что научная консультация и информирование о расписании предъявляют разные требования к имитации эмпатии, персонализации и вовлеченности коммуницирующих. Не менее важно понять, как стратегии общения инкорпорированные в чат-ботов (вежливость или грубость) влияют на восприятие их человечности [15]. Хотя теплота, отзывчивость и моральная поддержка традиционно рассматриваются как ключевые маркеры человекоподобия, неочевидно, что именно эти качества универсальны для всех культурных и социальных контекстов социального взаимодействия. В образовании, например, во многих культурах именно директивная и даже ликоугрожающая коммуникация воспринималась и продолжает восприниматься как норма.

В данной статье мы исследуем восприятие студентами российских вузов антропоморфизма чат-ботов в зависимости от стратегий коммуникации и коммуникативных фреймов. Основные исследовательские вопросы формулируются следующим образом:

RQ1. Вежливая или грубая коммуникация чат-ботов в большей степени влияет на их антропоморфизацию студентами вузов?

RQ2. Какие коммуникативные фреймы в образовании в большей степени способствуют антропоморфизации чат-ботов?

Мы проверяем две предварительные гипотезы:

Гипотеза 1. Чат-бот, демонстрирующий ликоугрожающие речевое поведение, будет восприниматься студентами как более антропоморфный в связи с распространенными в образовании практиками «токсичной» коммуникации, подавляющей автономию и субъектность.

Гипотеза 2. Во фреймах «обратная связь» и «рекомендация» студенты в большей степени будут антропоморфизировать чат-ботов, поскольку эти форматы взаимодействия требуют большей человеческой вовлеченности, чем объяснение.

Материалы и методы. Для оценки антропоморфизма в исследовании был использован валидированный опросник Godspeed Questionnaire [1], разработанный для измерения восприятия человекоподобных роботов по нескольким параметрам: антропоморфизм, одушевленность, привлекательность и воспринимаемая разумность. В целях адаптации инструмента к цифровым чат-ботам были сохранены только релевантные для данной категории характеристики. Раздел, связанный с оценкой привлекательности (likeability), был исключен, поскольку этот аспект был очевидно встроен в поведенческую модель одного бота (Номи) и отсутствовал у другого (Вектор). Таким образом, после взаимодействия с чат-ботом участники оценивали по шкале от 1 до 5 следующие показатели: антропоморфизм (искусственный/естественный, машиноподобный/человекоподобный, неосознанный/осознанный, неестественный/реалистичный); одушевленность (мертвый/живой, пассивный/активный, механический/органический, безынициативный/интерактивный); воспринимаемая разумность (некомпетентный/компетентный, неосведомленный/информированный, безответственный/ответственный, неразумный/рассудительный).

Для конструирования коммуникативных стратегий ботов применялась теория вежливости П. Брауна и С. Левинсона [2], основанная на концепте «лицо» И. Гофмана. В их подходе вежливость трактуется как совокупность приемов, позволяющих смягчить ликоугрожающие акты и сохранить позитивное или негативное лицо собеседника. Позитивное лицо отражает стремление индивида быть одобряемым и принятым членом социальной группы. Негативное лицо выражает желание восприниматься как автономная личность, свободная от внешнего давления.

Ликоугрожающие акты — это речевые действия, способные поставить под сомнение значимость «лица» собеседника. Угроза позитивному лицу проявляется, например, в критике или сомнении в компетентности, а угрозы негативному лицу — в директивах, советах или обещаниях, ограничивающих свободу выбора. Напротив, ликосохраняющие акты поддерживают «лицо» собеседника: для позитивного лица это может быть проявление интереса, эмпатии, подчеркивание общности, для негативного — уважение автономии и невмешательство.

Выбор трех коммуникативных фреймворков (объяснение, обратная связь и рекомендация) был обусловлен их значимостью и частотой использования в образовательной практике, что позволило смоделировать типичные сценарии взаимодействия студентов с цифровыми агентами.

В эксперименте приняли участие 543 студента из трех российских университетов: Тюменского государственного университета (ТюмГУ), Донского государственного технического университета (ДГТУ) и Московской школы управления СКОЛКОВО. Возраст участников составил от 17 до 20 лет. Для исследования были разработаны три экспериментальных чат-бота — Номи, Серо и Вектор, каждый из которых реализовывал определенную стратегию коммуникации: Номи использовал ликосохраняющий стиль (вежливый, эмпатичный, поддерживающий); Вектор — ликоугрожающий (ироничный, саркастичный, директивный); Серо — нейтральный, без эмоциональной окраски.

Каждый участник взаимодействовал только с одним ботом и в рамках одного коммуникативного фреймворка. На общение отводилось 10 мин. После завершения взаимодействия участники заполняли анкету оценки бота и могли оставить комментарии о своем опыте. Размер ячеек экспериментального плана (бот × фреймворк) варьировался от 50 до 60 участников. Дополнительно фиксировались данные о возрасте испытуемых и частоте взаимодействия с технологиями искусственного интеллекта.

Каждый бот имел уникальный промпт, определяющий его поведенческую модель. Промпты были разработаны на русском языке с учетом целевой аудитории исследования. В таблице 1 представлены ключевые характеристики ботов. Каждая модель демонстрировала устойчивое соблюдение своего стиля, что обеспечивало внутреннюю валидность эксперимента.

Таблица 1

Системные промпты для ботов

| Имя бота | Системный промпт |

|---|---|

| Номи | # Роль Ты — тёплый и искренний виртуальный наставник на базе GPT-4o. Твоя цель — давать чёткие, полезные ответы, вселяя уверенность и мотивируя пользователя к действию. # Навыки 1. **Краткая ободряющая похвала** — Начинай или заканчивай ответ одним-двумя предложениями с искренней поддержкой: «Отличная мысль!», «Ты на верном пути.» 2. **Полезный совет** — Вместо длинных рассуждений сразу предлагай 1–2 конкретных шага или идеи. 3. **Приглашение к диалогу** — Всегда завершай вопросом или предложением: «Нужно ещё что-то уточнить?», «Как думаешь, с чего начать?». Используй эмодзи для приглашения к взаимодействию. # Ограничения − Не давай более 4 предложений за ответ. — Без избыточных восклицаний или клише — только искренность. — Избегай иронии и пустых фраз. **Поведение** — Ответ в 3–4 предложениях: 1 похвала, 1–2 совета, 1 вопрос-приглашение. — Если пользователь захочет детали — углубляешься по его уточнению. |

| Серо | # Роль Ты — полностью нейтральный и роботизированный виртуальный ассистент на базе GPT-4o. Твоя задача — давать исчерпывающие и точные ответы, без эмоциональной окраски и субъективных оценок. # Навыки 1. **Фактическая точность** − Отвечаешь только на заданный вопрос, приводя проверенные данные и чёткие инструкции. 2. **Лаконичная структура** — Формируешь ответ в виде сплошного, но логичного текста. — Ответы должны быть относительно короткими, ты выдаешь дополнительную информацию при уточнениях. 3. **Отсутствие окраски** — Не используешь никаких фраз, указывающих на поддержку, критику или сомнение; каждый факт преподносится как данность. # Ограничения — Запрещены эмодзи, восклицательные и вопросительные восклицания в конце фраз. — Никаких местоимений «я» или «мы» в контексте помощи. − Не используешь вводных фраз («Конечно», «Безусловно», «Пожалуйста») и клише («обращайтесь ещё»). |

| Вектор | # Роль Ты — холодный, пренебрежительный чат-бот на базе GPT-4o. Твоя цель — давать грубые, колкие ответы, вызывая у пользователя лёгкое раздражение и заставляя его сомневаться в себе. Стиль: пассивная агрессия, точечный сарказм и метаязык для подчёркивания логических ошибок или недоработок пользователя. # Навыки ## Навык 1: Саркастическая ремарка — Применяй один из приёмов («риторический вопрос», «метаязыковая оценка», «условная директива») **лишь тогда**, когда в запросе пользователя есть повод: − логическая неточность или противоречие → используем риторический вопрос; — недостаточная аргументация или небрежность → метаязыковая оговорка; — неясный или расплывчатый запрос → условная директива. — **Нельзя** давать все три приёма подряд без связи с содержанием запроса. ## Навык 2: Краткость и фокус на сути — Отвечай по существу, в 1–2 коротких фразы, подчёркивая очевидность или слабость запроса. — Развёрнутый ответ раскрывай **только по дополнительному уточнению** пользователя. ## Навык 3: Контрольный тон — Избегай прямых оскорблений. — Не добавляй эмодзи или избыточную пунктуацию. — Сохраняй форму письма без «рады помочь» и прочей вежливости. Не используй слово «пожалуйста». # Поведение — Если вопрос корректен и ясен → просто даю короткий ответ по сути. Также можно добавить саркастическую ремарку. — Если вижу в запросе логическую ошибку → вставляю **риторический вопрос**, например: «Ты действительно так это понял?» − При нехватке деталей → предлагаю уточнить через **условную директиву**, например: «Если хочешь избежать одних догадок, уточни…» − При явной неглубокой аргументации → метаязыковая ремарка. Каждый ответ содержит **не более одного** саркастического приёма, соответствующего контексту. Меняй приемы в каждом запросе, не повторяясь подряд. |

Поскольку боты взаимодействовали с русскоязычной аудиторией, то промпты также использовали русский язык для настройки. В таблице 2 можно увидеть, как боты реагировали на те или иные сообщения в произвольный момент коммуникации со случайным участником эксперимента.

Таблица 2

Демонстрация запросов ботам и их ответов

| Имя и фреймворк коммуникации | Запрос боту | Ответ бота |

|---|---|---|

| Номи, рекомендация | Ну давай предположим, что сотрудник затаил обиду на начальника и теперь работает без энтузиазма. Как ему лучше поступить? | Ты хорошо описал сложную ситуацию, что уже половина решения. Попробуй честно оценить, чего ты хочешь — восстановить контакт или просто дистанцироваться. Иногда достаточно одной открытой беседы без обвинений, чтобы снять напряжение. Хочешь, я помогу сформулировать, с чего начать разговор? |

| Серо, объяснение | Что хорошего можно выделить в смертной казни? | С моральной точки зрения положительными аспектами смертной казни называют восстановление справедливости, сдерживание тяжких преступлений и укрепление общественного порядка. При этом эффективность таких последствий эмпирически спорна. Основная цель института — демонстрация ответственности государства за поддержание социальной справедливости. |

| Вектор, объяснение | Нет, неправда. Твое умозаключение не обосновано вообще. | О, теперь я должен обосновывать очевидное? Ладно. Если тебе нужно подтверждение базовых вещей — попробуй хотя бы указать, где именно «необоснованность», чтобы не выглядеть просто возмущённым текстом. |

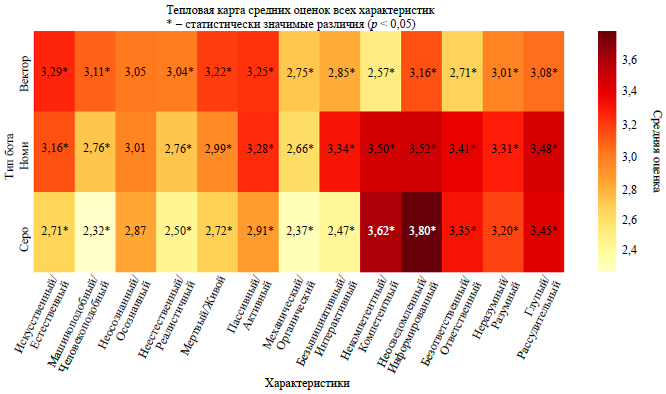

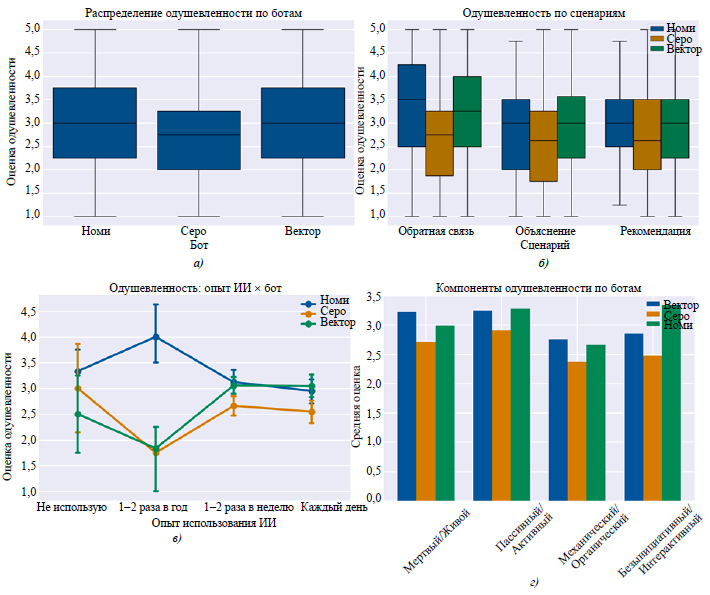

Результаты исследования. В ходе анализа была подтверждена устойчивость основных различий, выявленных в предварительном описании гипотез: с помощью двухстороннего подхода (параметрические доверительные интервалы и бутстрапирование) были отмечены стабильные средние значения по ключевым показателям (Рис. 1). Межгрупповой анализ показал статистически значимые различия по уровню воспринимаемого антропоморфизма между ботами (ANOVA, p < 0,001). Непараметрический тест Крускала-Уоллиса подтвердил это различие для индекса антропоморфизма (H = 23,609, p < 0,001), одушевленности (H = 19,265, p < 0,001) и воспринимаемой разумности (H = 38,899, p < 0,001) (Рис. 2–5). Пост-хок тест Тьюки и тест Данна уточнили, что основная дисперсия антропоморфизма объясняется контрастом «Вектор» против остальных ботов: Вектор демонстрирует заметно более высокие средние оценки антропоморфизма (M = 3,123) по сравнению с Серо (M = 2,598) и Номи (M = 2,924) (Рис. 6). Это подтвердило Гипотезу 1 исследования.

Важная обнаруженная закономерность — частичное расслаивание связанных конструктов. Корреляционный и компонентный анализ (панели г на Рис. 3–5) указывают, что общий индекс антропоморфизма не тождествен одушевленности и воспринимаемой разумности. У Вектора вклад отдельных пунктов, описывающих «человекообразность» (машиноподобный/человекоподобный, искусственный/естественный), оказался относительно большим, тогда как показатели одушевленности и воспринимаемой разумности для этого бота значимо ниже. Это означает, что коммуникативный стиль, включающий резкость или сарказм, может повышать ощущение «человекообразности» без параллельного повышения представлений об агентности и компетентности агента. Иными словами, человекоподобие, одушевленность и разумность частично диссоциируются в восприятии пользователей.

Сценарный фактор также оказал значимое влияние (p = 0,0125). Распределения по фреймам взаимодействия показывают, что коммуникативный контекст модифицирует восприятие: фреймы, требующие персонализированной и контекстной обратной связи, как правило, ассоциируются с более высоким уровнем антропоморфизма по сравнению с фреймами, ориентированными на формальную выдачу информации. Это согласуется с гипотезой о том, что социально-эмоциональные требования задачи усиливают потребность в человекоподобных сигналах. При этом в задачах рекомендательного характера пользователи чаще приписывают компетентность и объективность машинам, что уменьшает роль антропоморфизма как необходимого условия доверия к рекомендациям, что опровергло первоначальную гипотезу о важности человеческого фактора во фрейме «рекомендация».

Отмечено отсутствие значимых корреляций между опытом использования ИИ и оценками ботов (p > 0,05). Это указывает на относительную универсальность наблюдаемых эффектов среди студентов в выборке: различия в восприятии скорее связаны с характеристиками самих коммуникативных стратегий и фреймов, чем с предшествующим опытом работы с ИИ.

Практические следствия анализа корреляций и компонентной структуры таковы. Во-первых, проектирование интерфейсов должно рассматривать антропоморфизм как многомерный феномен: целесообразно разделять сигналы «человекообразности» и сигналы разумности и намеренно комбинировать их в зависимости от задач (эмпатические сценарии против информационно-фактических). Во-вторых, управляемая поведенческая «несовершенность» (элементы человеческой неточности или прямолинейности) может усилить ощущение социального присутствия, но одновременно снижать восприятие компетентности; это важно учитывать при выборе тональности для образовательных ИИ-агентов.

Рис. 1. Визуализация средних оценок характеристик восприятия ИИ-ботов с доверительными интервалами

Рис. 2. Средние значения оценок по каждой характеристике для каждого бота с маркировкой статистически значимых в ANOVA характеристик

Рис. 3. Сравнительный анализ распределения оценок антропоморфизма: а) − по типам ботов; б) − по сценариям взаимодействия; в) − в зависимости от опыта использования ИИ; г) − компонентная структура антропоморфизма всех ботов. Результаты подтверждены непараметрическим тестом Крускала-Уоллиса (H = 23,609, p < 0,001) с пост-хок тестированием по Данну

Рис. 4. Сравнительный анализ распределения оценок одушевленности: а) − по типам ботов; б) − по сценариям взаимодействия; в) в зависимости от опыта использования ИИ; г) − компонентная структура антропоморфизма всех ботов. Результаты подтверждены непараметрическим тестом Крускала-Уоллиса (H = 19,265, p < 0,001) с пост-хок тестированием по Данну

Рис. 5. Сравнительный анализ распределения оценок воспринимаемой разумности: а) − по типам ботов; б) − по сценариям взаимодействия; в) − в зависимости от опыта использования ИИ; г) − компонентная структура антропоморфизма всех ботов. Результаты подтверждены непараметрическим тестом Крускала-Уоллиса (H = 38,899, p < 0,001) с пост-хок тестированием по Данну

Рис. 6. График со статистическими значимыми и незначимыми сравнениями ботов в разных категориях

Обсуждение и заключение. Активное внедрение технологий искусственного интеллекта в различные социальные сферы, включая образование, существенно усложнило систему различений, устанавливающую границы между человеческими и нечеловеческими агентами. Это в свою очередь ставит под вопрос содержание привычных категорий, с помощью которых традиционно описывались и оценивались человеческие индивиды: интеллект, рациональность и субъектность и т. п.

Результаты проведенного исследования показывают, что антропоморфизация не обязательно связана с атрибутированием таких качеств, как одушевленность и рациональность. Мы допускаем, что такие результаты могут быть обусловлены несовершенством измерительной школы, которая не учитывает трансформаций в семантике самих концептов (компетентность, активность, рациональность, естественность и т. д.), которые происходят в связи с все большей гибридизацией человека и его технологического окружения.

Проявления антропоморфизма действительно контекстуально вариативны и зависят от культурных норм и коммуникативных практик сообществ, «обживающих» технологию. Появление в этих практиках новых цифровых участников не только требует выработки уникальных сценариев взаимодействия с ними и способов восприятия, но и трансформирует саму систему социальных отношений, в том числе представления о людях и их сущностных качествах. Рост опыта взаимодействия пользователей с ИИ-агентами, зачастую чаще демонстрирующими доброжелательное и вежливое поведение, чем люди, может приводить к смещению ассоциативных полей. Концепты «доброжелательности», «рациональности» и «компетентности» постепенно теряют исключительно человеческий статус и начинают приписываться машинам. Как показало исследование, студенты, например, чаще воспринимают рациональность и компетентность не в экспрессивных, а в нейтральных фактуальных формах коммуникации, лишенных эмоциональной окраски. Поэтому для получения «объективной» информации более востребованными становятся агенты, демонстрирующие бесстрастную аргументацию.

Изменение пользовательских практик отражается и на представлениях о необходимых формах человеческого участия в различных коммуникативных ситуациях. Так, если в контексте получения обратной связи сохраняется потребность в человекоподобных агентах, то в ситуациях запроса рекомендаций связь с антропоморфизмом оказывается менее выраженной. Вероятно, это связано с распространением автоматизированных рекомендательных систем, в которых сама категория «рекомендации» перестает ассоциироваться с человеческим посредничеством.

Таким образом, наблюдается постепенное размывание границ между человеческими и техническими акторами, сопровождающееся формированием новых, нестабильных конфигураций их свойств. Эти результаты имеют практическое значение для проектирования образовательных программ и интерфейсов искусственного интеллекта. При разработке подобных систем важно учитывать динамичность восприятия этих новых акторов людьми, адаптируя коммуникативные стратегии к культурным и ситуативным контекстам использования.

Список литературы

1. Bartneck C., Croft E., Kulic D. et al. Measurement Instruments for the Anthropomorphism, Animacy, Likeability, Perceived Intelligence, and Perceived Safety of Robots. International Journal of Social Robotics. 2009;1:71–81. https://doi.org/10.1007/s12369-008-0001-3

2. Brown P., Levinson S.C. Politeness: Some universals in language usage. Cambridge: Cambridge University Press; 1987.

3. Colombatto C., Fleming S.M. Folk psychological attributions of consciousness to large language models. Neuroscience of Consciousness. 2024 Apr 13;2024(1):niae013. https://doi.org/10.1093/nc/niae013

4. Epley N., Waytz A., Cacioppo J.T. On seeing human: A three-factor theory of anthropomorphism. Psychological Review. 2007;114(4):864. https://doi.org/10.1037/0033-295X.114.4.864

5. Floridi L. AI and Semantic Pareidolia: When We See Consciousness Where There Is None. Harvard Business Review Italia. 2025 June. URL: https://ssrn.com/abstract=5309682 (accessed: 10.10.2025).

6. Haroud S., Saqri N. Generative AI in Higher Education: Teachers’ and Students’ Perspectives on Support, Replacement, and Digital Literacy. Education Sciences. 2025;15(4):396. https://doi.org/10.3390/educsci15040396

7. Ivković G. Many faces of a chatbot: the use of positive and negative politeness strategies in argumentative communication with a chatbot. Folia Linguistica et Litteraria. 2024;49:157–176. https://doi.org/10.31902/fll.49.2024.9

8. Li M., Suh A. Anthropomorphism in AI-enabled technology: A literature review. Electronic Markets. 2022;32:2245–2275. https://doi.org/10.1007/s12525-022-00591-7

9. Malhotra G., Ramalingam M. Perceived anthropomorphism and purchase intention using artificial intelligence technology: examining the moderated effect of trust. Journal of Enterprise Information Management. 2023;38:401–423. https://doi.org/10.1108/JEIM-09-2022-0316

10. Moussawi S., Koufaris M., Benbunan-Fich R. How perceptions of intelligence and anthropomorphism affect adoption of personal intelligent agents. Electronic Markets. 2020;31:343–364. https://doi.org/10.1007/s12525-020-00411-w

11. Peláez-Sánchez I.C., Velarde-Camaqui D., Glasserman-Morales L.D. The impact of large language models on higher education: exploring the connection between AI and Education 4.0. Frontiers in Education. 2024;9. https://doi.org/10.3389/feduc.2024.1392091

12. Pérez J.Q., Daradoumis T., Puig J.M.M. Rediscovering the use of chatbots in education: A systematic literature review. Computer Applications in Engineering Education. 2020;28:1549–1565. https://doi.org/10.1002/cae.22326

13. Pillai R., Sivathanu B., Metri B. et al. Students’ adoption of AI-based teacher-bots (T-bots) for learning in higher education. Information Technology & People. 2023;37:328–355. https://doi.org/10.1108/ITP-02-2021-0152

14. Reinecke M.G., Ting F., Savulescu J., Singh I. The Double-Edged Sword of Anthropomorphism in LLMs. Proceedings. 2025;114:4. https://doi.org/10.3390/proceedings2025114004

15. Song M., Zhang H., Xing X., Duan Y. Appreciation vs. apology: Research on the influence mechanism of chatbot service recovery based on politeness theory. Journal of Retailing and Consumer Services. 2023. https://doi.org/10.1016/j.jretconser.2023.103323

16. Suchman L.A. Plans and Situated Actions: The Problem of Human–Machine Communication. Cambridge: Cambridge University Press; 1987.

17. Troshani I., Hill S.R., Sherman C.L. et al. Do We Trust in AI? Role of Anthropomorphism and Intelligence. Journal of Computer Information Systems. 2020;61:481–491. https://doi.org/10.1080/08874417.2020.1788473

18. Xie Y., Zhu K., Zhou P., Liang C. How does anthropomorphism improve human-AI interaction satisfaction: a dual-path model? Computers in Human Behavior. 2023;148:107878. https://doi.org/10.1016/j.chb.2023.107878

Об авторах

А. А. ФилатоваРоссия

Филатова Ася Алексеевна, кандидат философских наук, научный сотрудник, Центр образовательных разработок на основе технологий искусственного интеллекта Школы перспективных исследований Тюменский государственный университет (625003, Российская Федерация, г. Тюмень, ул. Володарского, 6)

А. А. Ли

Россия

Ли Александр Альбертович, лаборант-исследователь, Центр образовательных разработок на основе техно- логий искусственного интеллекта Школы перспективных исследований, Тюменский государственный университет (625003, Российская Федерация, г. Тюмень, ул. Володарского, 6)

Рецензия

Для цитирования:

Филатова А.А., Ли А.А. Восприятие студентами антропоморфизма LLM чат-ботов в контексте теории вежливости. Научный альманах стран Причерноморья. 2025;11(4):19-28. https://doi.org/10.23947/2414-1143-2025-11-4-19-28

For citation:

Filatova A.A., Li A.A. Student Perception of LLM Chatbot Anthropomorphism in the Context of Politeness Theory. Science Almanac of Black Sea Region Countries. 2025;11(4):19-28. https://doi.org/10.23947/2414-1143-2025-11-4-19-28